昨年、画像の分野では「Midjourney」や「Stable Diffusion」といった“ユーザーが入力したテキストに応じて、AIが画像を生成する画像生成AI”が注目を集めたが、今年は音楽シーンでも生成AIに大きな注目が集まった。

2023年に音楽シーンで起きたAIに関する大きな動き

その中で今年大きな注目を集めた生成AIの話題のひとつといえば、AIによる実在するアーティストの音声を使ったAI音声カバーだろう。

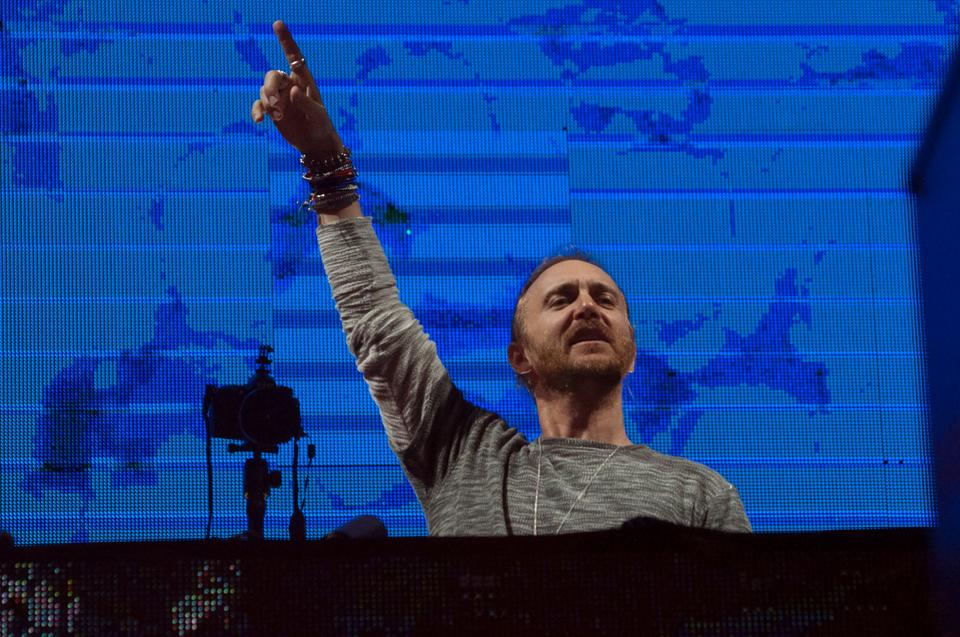

今年1月、David Guettaは、AIが生成したEminemの音声を使った未発表曲「Emin-AI-em」を公開。賛否両論の大きな反響を得た。

このことについて、David Guettaは、後にBBCのインタビューで「(AIの音楽利用に関する)議論を呼び起こし、その意識を高めることが目的だった」と述べている。また「音楽の未来はAIにあると確信している」とAIを好意的に捉えていることを明かす一方で、「人間にとって代わるものではなく、あくまで道具として利用するものである」との認識を示した。ちなみにデヴィッド・ゲッタは「Emin-AI-em」を商業リリースする予定はないとしている。

現在、音楽シーンでは生成AIによって自動生成された音楽に対する懸念がある。生成AIは基本的に、既存の音楽や画像などを学習することで新しくクリエイティブを生成するが、問題視されているのは、その学習が合法的に行なわれているか否かということだ。

この問題において、最も注目を集めたのは今春物議を醸したAI音声カバー問題だろう。この問題では、無許可でDrakeなど有名アーティストの音声をAIに学習させることで、架空の有名アーティスト同士のコラボ曲や新曲が大量に生成され、物議を醸した。このAIによるディープフェイク楽曲の乱立に対し、アーティストやレコード会社は大きく反発。権利侵害を理由に多くのディープフェイク楽曲が削除されることとなった。

このような事態が起こるなかで、他のアーティストに先駆けて、この技術を有効活用する方法を提示したのが、かねてからAI音声カバーに対して、肯定的なスタンスを表明してきたGrimesだ。

GrimesはAI音声カバーについて、

私の声を使用したAI音声音源のうち、成功した曲については、コラボするアーティストと同じ条件で、ロイヤリティの50%を分け合いたいと思います。罰則なしで私の声を自由に使ってください。私はどのレーベルにも所属していないので、法的な拘束はありません。

と、ほかのアーティストよりも一歩深く踏み込んだ発言をSNSに投稿しており、自身のスタンスを反映するかのように自分の声をAIにカバーさせるAI音声ソフト「Elf.Tech」も公開。AI利用に伴う権利侵害をクリアにする形で音楽分野における合法的なAI活用の一例を示した。また、Elf.Techに続くツールとして、DJ Freshもアーティストの権利を保護し、適正な報酬の支払いを保証することを目的に開発したAI音声変換ソフト「Voice-Swap」を発表。このツールは、音声を提供したアーティストに対し、AIボイスモデルの使用による収益を比例配分方式で支払われるシステムを採用していることでも、にわかにアーティストたちの間で注目を集めた。

世間的に音楽の分野において、生成AIが最も今年注目を集めたのは、The Beatlesが“最後の新曲”「Now And Then」制作において、AIによる音源分離を活用していたということだろう。今年6月、Paul McCartneyは英・BBC Radio4の番組『Today』に出演し、AIによる音源分離を使用してJohn Lennonが残した古いデモテープから歌声を抽出し、ボーカルのみのステムを生成。それを用いながらThe Beatlesの“最後の曲”を完成させたことを明らかにした。

ちなみにAIによる音源分離は、すでに音楽分野においては最もポピュラーな活用法のひとつになっており、DJソフト「djay Pro」やiZotopeのオーディオリペアツール「RX」のほか、LINE MUSICなど音楽プラットフォームのカラオケ機能でも活用されている。さらにこの技術は、現在の音楽制作の現場においては、Apple MusicやAmazon Music Unlimitedといった音楽ストリーミングサービスで配信されている「空間オーディオ」フォーマットの音源制作にも活用されている。しかし、このようなAIテクノロジーを実際に音楽制作で用いたPaul McCartney本人も、音楽制作に生成AIを活用することに対しては、先述の番組でAIの可能性自体には期待しつつも、この先のことはわからないと慎重論とも言える発言をしている。

一般的に“AIを使った音楽”と聞くと、“ボタンひとつでAIが自動で作る音楽”をイメージしがちだ。今年はそのイメージに限りなく近いと言える、文章で打ち込んだプロンプトから音楽1曲まるっと作成できる音楽生成AIも、一般向けに公開された。このタイプのツールでは、Googleの「MusicLM」(*この記事を執筆している時点では試験公開中)やStability AIの「Stable Audio」があるが、今年12月に入ってからは、特にX(旧Twitter)上では、同様のツールである「Suno AI」が話題を呼んだ。

You can make great music, whether you're a shower singer or a charting artist. No instrument needed, just imagination.

— Suno (@suno_ai_) December 20, 2023

Make your song today at https://t.co/HG7qM2Jhr5 🎧 pic.twitter.com/vVbWiSPouJ

ミュージシャンとAIの専門家からなるスタートアップ企業のSunoが開発するSuno AIは、先述の代表的なツールと同様に文章で指示するだけで音楽を自動生成できるが、生成される音楽のクオリティが予想以上に高いことから、プロのミュージシャンも驚きの声を上げており、一時Xでは大きなバズとなっていたことも記憶に新しい。

一方で、従来のDAWのように生成AIを音楽制作ツールとして使用できるツールの発展も見られた。例えば、OpenAIの大規模言語モデル GPT-4を搭載したDAW「WavTool」では、AIの提案をユーザーが取捨選択しながら楽曲のフレーズやビートなどの作成が可能だ。

また、Hit'n'Mixが“初のAI DAW”と謳う「RipX DAW」の最新版では、Stable Audio系の音楽生成AIで作成した音源を読み込み、音源分離しステム化するだけなく、その切り離したステムをRipX上でユーザーがMIDIのように編集したり、音色を交換したり、エフェクトをかけたりといったより従来のDAW的な操作が行なえる。

AI利用における音楽業界の取り組み

しかし、今年は音楽シーンでの生成AIの台頭により、その活用に関しては、昨年画像の分野で見られた「人間の仕事がAIに奪われることになるかもしれない」というAI脅威論とも言えるAIに対する懸念やAI音声カバーに見られた法と倫理面での問題など、ネガティブな要素が見受けられるようになった。一方でDavid GuettaやGrimesのようにAIに可能性を感じるアーティストも少なからずいることも事実だ。分散型音楽プラットフォームのAudiusでは、そういったアーティストに向けて、アーティストの権利を侵害することなくAI生成音楽を公開できる機能「AI Music Attribution」を公開している。

また、2023年のSXSWでは、人間の創造性と文化を支援する方法でのAI技術の開発・利用の保証に取り組むクリエイティブ産業団体や労働組合などによる国際的な連合・キャンペーンとして「Human Artistry Campaign(HAC)」が発足。アーティスト、パフォーマー、作家、アスリートなど、さまざまな分野の創造者を代表する団体が30以上参加したこのキャンペーンでは、AIを使用して芸術作品を作る際の原則が概説され、アーティストやその作品に敬意を払うことや、AIがどのように作品を生成したかなど透明性を確保すること、著作権、知的財産を含む現行法を遵守することが強調された。音楽シーンでは、HACに参加するレコード会社のUniversal Music Group(UMG)と音楽制作プラットフォームのBandLabが共同で「AIの倫理的使用及びアーティストの権利の保護に対する共通のコミットメントを推進していく」と発表している。

一方、YouTubeは今年8月に「AIを音楽に活用するための基本的な考え方(AI Music Principles)」の制定とUniversal Music Group(UMG)のアーティスト、作詞・作曲家、プロデューサーが参加する「YouTube Music AI インキュベーター」の発足について発表。生成AIがクリエイティビティの新しい扉を開くなか、この急速に進歩する分野において、YouTubeと音楽業界は、これまでの長期的な協働関係を継続し、責任を持ってAIを活用。音楽業界と連携しながら、責任ある改革の追求とクリエイティビティの強化を目指すことや、AIがクリエイティビティの新時代への扉を開く一方で、適切な権利保護と音楽業界への機会提供がなければならないとする考えも表明している。

その取り組みの一環として、YouTubeは今年11月にGoogle DeepMindが開発する先進的な音楽生成AIモデル「Lyria」を利用した「Dream Track for Shorts」と「Music AI Tools」というふたつのAI音楽生成ツールを発表。

Dream Track for Shortsは、現在実験的に一部のクリエイター向けに提供されている「YouTube Shorts」向けの機能で、Charli XCX、Siaら数組のUMG所属アーティスト参加しており、ユーザーがテキストで作成したい音楽のスタイルや歌詞のテーマなどを入力し、実験に参加しているアーティストの中から好きなアーティストを選択すると、YouTube ShortsのBGM用にそのアーティストの音声を使用した短い楽曲を作成できる(最大30秒まで)。

一方、Music AI Toolsは音楽制作の現場向けの機能だ。この機能では、鼻歌から新しいギターリフを作る、作成中のトラックをレゲトン調など別のテイストに置き換えるといった処理がAIにより簡単に行なえるようになる。YouTubeによると、このツールのテストは、今年後半からMusic AI Incubatorの参加者を対象に行なわれる予定だ。

このように今年大きな話題となった音楽生成AIだが、大別すると音楽を1曲作りあげるもの(MusicLMやSuno AI)とあくまで人間の作曲能力の補助やクリエイティビティの拡張を後押しするツール(音源分離やAI音声カバー、AI DAWなどの作曲アシストツール)のふたつに分けることができ、今後もそのふたつが大きな発展の流れとして予想される。

しかし、あるAIの研究者/アーティストは、従来のプラグインのようにアーティストが使いたいと思えるAI制作ツールが少ない点と、AIならではの音楽表現というものが確立されていない点を、現状の音楽生成AIの課題として指摘している。

そのなかで、AIならではの音楽表現の可能性を考えた場合、AIを活用したリアルタイムでの音色変換はその可能性のひとつだと言えるだろう。これは動画のジェネレーティブアートのように、音楽が進む時間軸に合わせて滑らかに音色が変容していくようなものだと筆者個人は考えている。そのようなリアルタイムでの音色変化は、音楽制作のためのAIツールを開発する会社・Neutoneが現在無償提供しているAIプラグイン「Neutone Plugin」のようなツールが発展進化し、普及していくことで認知されていくかもしれない。このような音楽生成AIと人間のアーティストの共創が促進されていくためのツールを開発していくことも今後の音楽生成AIデベロッパーにとっての課題になるだろう。

Neutone from Qosmo—AI Creativity & Music Lab on Vimeo.

音楽生成AIから新しい音楽クリエイティブは生まれるのか?

現在、音楽生成AIに肯定的なアーティストは、それを自分の能力を拡張するためのツールと捉えている。また、これまで音楽を作ったことがない人が、音楽生成AIで音楽を簡単に作れるようになることも、その人の能力の拡張とある意味では言えるだろう。

そのように音楽制作スキルが汎用化していくことに対して、脅威を感じるアーティストは先述したように少なからずいるが、一方では、音楽が簡単に作れるようになることで、もともと音楽を作れる作曲家や演奏家の価値が相対的に上がる、揺り戻しが起こるという意見もある。また、自分のオリジナル音楽を作れるようになることで誰に聴かせるでもない自分だけの音楽を日記的に作り個人的に楽しむ習慣が生まれるという意見もここ最近は見られるようにもなってきた。

個人的には、多くの人が音楽を作れるようになることで音楽全体のレベルが向上すると考えている。簡単に実写動画をアニメ風や3DCGに変換できる動画生成AIが登場したが、それを見ていると「今まで難しいと思って諦めていた3DCG制作が手軽にできるのでは?」と思えたのだ。こと音楽に関しては自身がDAWで作曲する経験があるため、AIに脅威を感じるよりもAIをツールとして活かす方向でその可能性を考えているが、他の分野でも専門家や心得がある人は、その分野でAIをツールとして活用方法することをすでに考えているに違いない。

そして、音楽においても、例えば、Rolandのベースシンセ「TB-303」を本来とは違う方法、つまり誤用することでアシッドハウスという新たな音楽ジャンルが生まれたように、人間がその使い方を試行錯誤していくなかで新しいAIならではの音楽表現が生まれるのではないだろうか?

目的と価値消失

#カルチャーはお金システムの奴隷か?

日本人が知らないカルチャー経済革命を起こすプロフェッショナルたち