人工知能(AI)はたびたび擬人化され、「AIが人間の知性を超える」「AIに仕事を取られる」などと人間にささやかれ、恐れられている。

その現象は音楽業界でも起こっていて、AIによる作曲や作詞が可能になったり、AI歌声合成ソフトに手が届きやすくなり、ディープフェイク音楽が出回ったり、音楽制作の形が大きく変わった。

いま、人が音楽を作る意味はどこにあるのだろうか。

今回は、生成AIを使った音楽制作の話題が世界中で多い「ヒップホップ」のジャンルに絞って考えてみる。実際にもラッパーの歌声をAIで生成したフェイク楽曲がリリースされたり、プロデューサー自らがボーカルにAIソフトを用いたり、比較的AIとの距離が近いように思えるヒップホップの音楽制作。現場はどのように変わってきているのだろうか?

ヒップホップのプロデューサーとして日本の最前線で活動する、KM氏に話を聞いた。

「要するにここを頑張れば食えるんじゃないか」

──KMさんは何をしている方なのか、改めてお聞きしても良いでしょうか?

KM:メインの仕事はプロデュース/ビートメイクです。昔は一時期、仕事としてDJをやってました。一応プロフィールにDJっていうのは書いてないんですけど、遊びの延長でやってる感じですね。今は楽しんでやろうかなって。

──ちなみに昔はどんなクラブでDJされてたんでしたっけ?

KM:六本木のクラブでも長らく回してたし、80年代からやってるようなディスコの小箱なんかでも5、6年やってましたね。

──なるほど。では今KMさんが作っている音楽とは違うような曲をかけることが多かったんですかね。

KM:そうですね。80’sのシンセポップとかキラキラしたディスコヒットを多く回してたんですが、元々ヒップホップが好きでDJになったので違和感があって。ただ今考えると、その経験もプロデュース業をやる時に役立ってると思います。例えばやっぱポップスを作るときに「80’sのあの感じの音」って言われたらすぐ分かるし、90年代のヒップホップのドラムの質感ももちろん分かるし、ニルヴァーナのギターの感じだったり、リンキン・パークのミクスチャー感だったり。そういうのが一通り分かるので、今考えてみたら良い10代、20代だったと思います。

──ビートはいつ頃から作り始めたんですか?

KM:中学の入学祝でMPCなどの機材をもらいました。周りにはギターとか楽器をやってる子は何人かいたので、自分はなにか違うことをやろうと思って。でも意外と地味な作業で、その時はあまり熱が入らなかったですね。

高校生くらいの時に先輩の影響でMacBookを買って、そのときから趣味でビートを作ってはいたんですが、本気を出しはじめたのは26歳ぐらいの時です。24歳ぐらいの時に建築系の会社に就職したんですけど、自分が好きなのはやっぱり音楽で、音楽の仕事がしたいと思って。

ちょっと真面目に理論から考えて作ってみようと思い、曲の分析をしだして。そのころの日本語ラップの音は、USのヒップホップの音に全然追いついてなかったんです。それでいろいろ真面目に聴き出して、「要するにここを頑張れば食えるんじゃないか」と。

大事なのは“使い方”

──最近はどうやってビートを作ってるんですか?

KM:制作自体は、ほとんどMac一台で行なってます。たまにギターを弾いたりマイクを使って自分の声を入れることもありますが、基本PC一台で完結しているスタイルです。

──PCにAIソフトなどを取り入れていますか?

KM:使ってる部分はあります。AIで制作してるって言うと多分みんながイメージするのって、「こんな雰囲気で、ジャンルはこれで」とか入れていくとパッて音楽が生成される感じだと思うんですけど、僕は今現在そういうものは使っていなくて。ただ、何か足りないなって思ったときに楽曲を解析させて、何が足りないかを見るとか。その結果を参考にして、音量のバランス、質感とかを見る。要するに最終的に曲を仕上げる段階で活用してます。

──そのソフトはいつ頃から使ってるんですか?

KM:1年前くらいかな。iZOTOPEっていう会社の「OZONE」っていうマスタリングソフトです。

ミックスバランスを解析して、足りない部分を補ってくれる補正ソフトみたいな感じですね。ジャンルごとに、例えばEDMのミックスバランスに整えてくれたり、ロックのミックスバランスに整えてくれたり、なんとなくサポートしてくれるんです。

──ジャンルごとに質感を変えられるんですね。すごい。

KM:そうなんです。でも、逆に僕はそういう機能が好きじゃなかったんですよ。自分で(音を)出すのが一番出るじゃんって思ってたんです。ただ、手詰まりで何をやればいいか分かんないってときに、例えばカニエ・ウェストの音源と自分の音源がどう違うのかっていうのを、解析して数字で教えてくれるんです。

大事なのは使い方で、全くマスタリングの知識がない方が、今の話を聞いただけでできるかって言ったら絶対できない。見なきゃいけないポイントとかがすごくたくさんあるから。それでもすごい時代になったなって思います。誰でもある程度USっぽいヒップホップを作れたり、プロっぽいロックにすることができたり、手っ取り早く仕上げられると思う。

──なるほど。事前の知識がある前提でAIソフトを使うと、アナログでマスタリングするよりも手っ取り早くそれっぽいところまで持っていけるってことなんですね。それ、ライティングも実は似た部分があると思います。ある程度Chat GPTなどのAIに書きたい内容を噛ませてから、最終的にライターが内容を調整したり加えたりして記事を完成させる方法も最近はありますよね。

KM:そういう話をすると、ゴーストライターというか、自分で書いてないんじゃないかって雰囲気になりがちなんですが、現状それだけだと無理じゃないですか。AIはあくまで道具なので。

AIがない時代の経験が基礎にあって、それにプラス、AIのサポートで違った視点を与えられる。スピードも格段に上がる。それこそ「今夜までに欲しいんです」みたいなタイトな納品が結構あるんです。「今夜ってあと3時間しかないですけど…」みたいな(笑)。

今までだとへなちょこのデモしか送れなかったところを、ある程度形が整った状態のデモを送れるっていうのは、AIの偉大な功績だと思うんです。あとはCM楽曲とかゲームのBGMとか、そういう制作の時にも向いてると思います。「こういう場面だから悲しい感じで」とか言われても、悲しさの度合いとかって人によるから分からないじゃないですか。

だからプロデューサーにイメージを伝える際に、「こんな感じのコード感で作って欲しい」って、AIを使って自分でデモを作れたり、そういう面では便利かも。

ヒップホップは「バックボーン」が大事なジャンル

──KMさんはヒップホップの音楽を作る時にAIを使うことはありますか?

KM:ヒップホップの分野は、AIを生かすのが比較的難しいイメージですね。いかんせん、人や音楽のバックボーンが大事になってくるジャンルなので。

──AIを取り入れることでその大事な部分が抜け落ちると。

KM:そういうイメージを持たれがちだと思います。

──tofubeatsさんが全曲AIボーカルを使ったEPをリリースしたり、DrakeがAI生成ソフトで自分の声でフェイクの曲を発表されて怒ったり。そういった事象についてはどう思いますか?

KM:素材としては取って代わられちゃう可能性があるってことですよね。僕も含めて、プロデューサーはみんなそのうち、ある程度AIを使い出すと思うんです。ただ、アーティストは結局「人間味」があるのが大事なんですよね。

綺麗なDrakeの声とDrakeよりも凝ったレベルの高いリリック。そんな曲ができたとしても、それはDrakeの作品じゃない。

「AIで作りました」って事実が乗っかったときに、いくら良い曲でも人の心が動くのかっていうのが、ちょっと分かんないです。最後まで隠してくれれば良いかもしれないですけど。だからビートメイクもレベルはグッと上がるし、生産量もクオリティも上がるのはすごいメリットだと思うんですけど、いくらAIを突き詰めても人の心を動かせるアーティストになれるのかは難しいところですよね。

──確かに。特にヒップホップは自分や仲間の誇りや苦しみを歌うものだと思うので、AIが作ったリリックに対して共感を持つのは難しいですよね。

KM:個人的に(メインの制作で)AIを使わない理由っていうのは、単純に自分で作るのが楽しいから。

自分のビートを自分の目指してるアーティストの雰囲気に近づけたくてずっと没頭しているタイプなんで。結果としてAIに解析させたら一発かもしれないんですけど、個人的にはそれを楽しんでやってたいし、過去の自分が尊敬するアーティストを自力で学びたいっていうのがあって、そういうめんどくさい道を僕は選んでるんです。

最近のソフトには「ヒューマナイズ」っていう人間のヒューマンエラーをランダムにパソコンがズラして再現する機能もあるにはあるんですが、そもそもヒップホップとかジャズって、とんでもなくズレてるんですよ。

KM:たとえばaru-2くんとかJディラのビートとか、ああいうズレを「ヨレ」とか「グルーヴ」っていうんですが、それもある程度は解析させたらできるとは思うんです。ただ、それでも追いつけない部分ってあるんですよ。

というのも、ヒップホップとかクラブミュージックって、今までになかったようなビートの打ち方だったり、今までになかったようなコード進行をどんどん実験的にやっていくようなジャンルだと思うんです。

AIは過去の音源を解析してそれっぽく仕上げてくれるのは上手。でも、そういうオリジナリティの高いことは、まだしばらくできないと思う。

KM:オリジナリティって“個性的”ってことですよね。これって理論的に整理されてて、スキルフルにしていけば良いって話でも無くて。AIがxxxTentacionのLook At Meのような、rawでdirtyなミックスを提案出来たのか?って考えると、出来なかったんじゃないかな。前例が無いから。

あとこれは例えとして、僕いろんなところで言ってるんですが、DJも昨今では楽曲解析をさせて、BPMも自動でシンクさせて、次にプレイする曲もある程度提案して貰えるシステムを使うのが既に一般的になっていて、そういうシステムの中ではヒューマンエラーってほとんど無いです。

そういうイベントの中で、目立つのって2人なんですよ。めちゃくちゃうまかったやつと、あと、めちゃくちゃ下手だったやつ。印象に残るのって、やっぱり「人間味」だと思うんです。

僕の友達でもDJプレイ、酔っ払ってめっちゃ下手なやついるけど、そういう夜の方が思い出に残ったり。ま、これは良くも悪くもですけど。

ただ、横並びでみんな上手いと、その人の名前って思い出せないんじゃないかな。

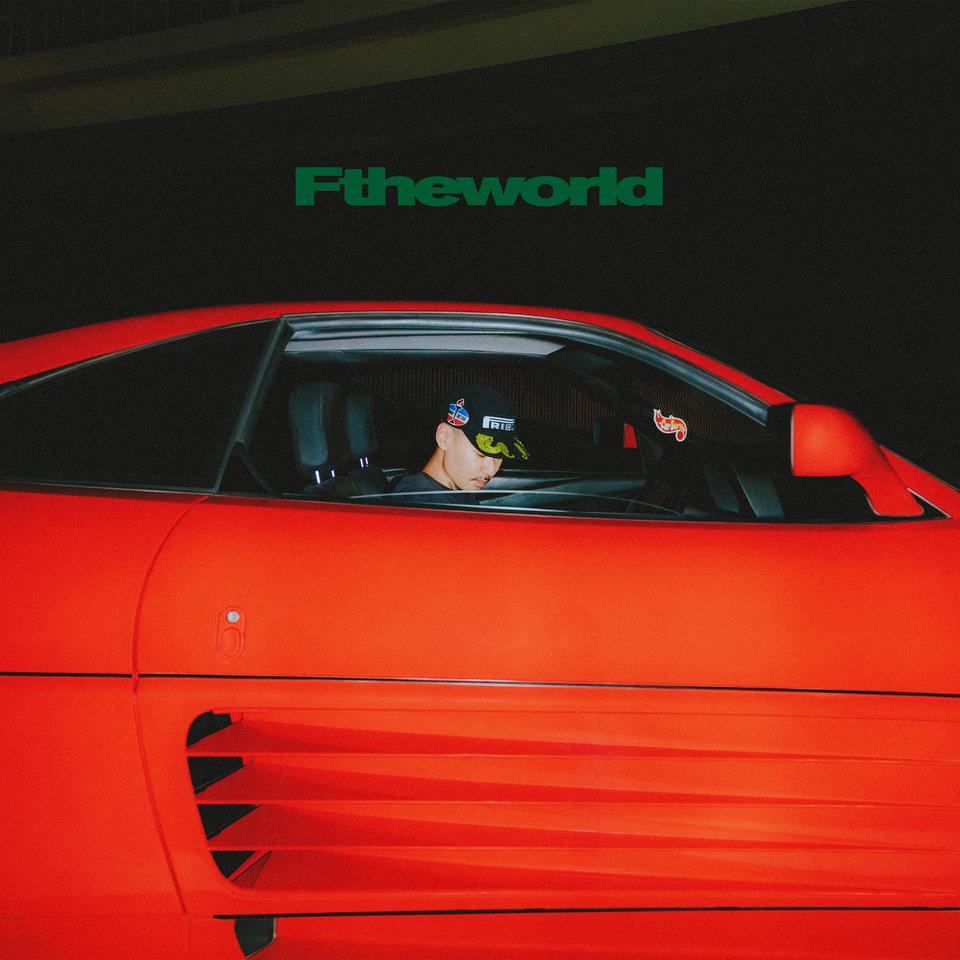

KM 『Ftheworld』

Release Date:2024/11/6

Label:Mary Joy Recordings

Tracklist:

01. Lost 2 (Ftheworld)

02. Gasoline

03. Ugly

04. Dawn Chorus (featuring Campanella & ermhoi)

05. two-seater (348)

06. ネコ

07. DANCELIXIR (featuring Lil’ Leise But Gold, Daichi Yamamoto & Skaai) (Album Version)

08. もう一度キスをして (feat. LEX & JP THE WAVY) (KM Remix)

09. Highnoon in the Living Room

10. Another day, I’m OK

11. Beautiful (featuring LEX)

12. Late Night (featuring Ryugo Ishida)

13. 20241009Produced by KM

Photo by Daiki Miura

Artwork by LAID BUG

■KM:X(Twitter) / Instagram

目的と価値消失

#カルチャーはお金システムの奴隷か?

日本人が知らないカルチャー経済革命を起こすプロフェッショナルたち