人工知能「Show and Tell」の驚くべき"的中率"

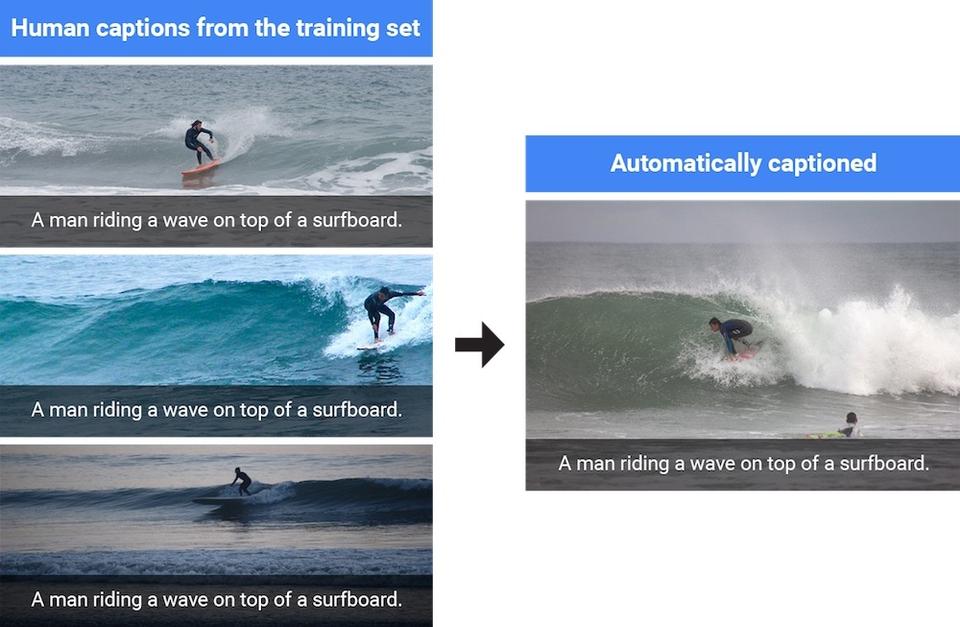

IDEAS LABグーグルで人工知能の研究を進める「Google Brain」チームは、多層ニューラルネットワークを用いた機械学習(Machine Learning)を応用した新しい技術を発表した。それは、「Show and Tell」と呼ばれる、画像にキャプションを付ける人工知能だ。

2014年に世界最高の画像キャプション技術のアルゴリズムを競うコンテスト「Microsoft COCO 2015 image captioning challenge」で1位となったシステムを元に、改良がグーグル社内で行われてきた。その結果、このニューラルネットワークは驚くべきことに、画像内に写る複数の物を認識するだけに留まらず、それらの関係性も説明ができるようになった。この学習のためにチームは、そのコンピュータービジョンと言語機能を強化し、例えば犬や芝生、フリスビーといったオブジェクトを識別するだけでなく、芝生の色や犬とフリスビーの相互関係も理解しキャプションを生成するチューニングが行なわれた。

グーグルの研究者たちによれば、「Show and Tell」が画像に写る情報を理解する精度は93.9%と、過去最高を更新した。2014年のInception V1画像認識で記録した精度の数値は、89.6%(これも驚くほど高い)で、改良する毎に精度が上がってきた。

チームが開発したこの技術は、見たことのないコンテクストや関係性に対しても、説明文をオリジナルで自動生成できるというから、恐ろしいほどにスマートな画像キャプション人工知能と言える。別の見方をすれば、物をコンテクストで認識できる精度が上がれば、いずれはグーグルが開発するスマートフォン、自動自走車、ロボット開発など、あらゆる分野で応用される時代が来る可能性もあるだろう。

「Show and Tell」の進化は、画像キャプションの精度が上がるだけにとどまらない。画像に写るコンテクストを人工知能が処理できれば、スマートフォンで撮影される膨大な数の写真に自動で注釈を付けてくれたり、SNSに投稿された画像用の注釈を自動で用意してくれる未来が来るかもしれない。それが実現した時、人は人工知能の提示する情報にイェスかノーかで答える立場になる可能性は拭えない。

喜ぶべきことに、グーグルの研究者たちは、「Show and Tell」をTensorFlowでオープンソース化して、誰でも利用可能にした。開発者は、このモデルを自由に使いコラボレーションを行いながら、機械学習や機械知能の研究を進められる。

目的と価値消失

#カルチャーはお金システムの奴隷か?

日本人が知らないカルチャー経済革命を起こすプロフェッショナルたち